The Three Ways in the AI Era -- Parte 1

El DevOps Handbook cumple 10 años. La IA acaba de romper la mitad.

El DevOps Handbook cumple 10 años este año. La mayoría de equipos nunca vivieron de verdad sus principios. Ahora la IA promete por fin desbloquearlos — y en cambio, está empeorando las cosas.

Este es el primer artículo de una serie de 6. Vamos a mirar los Tres Principios de Gene Kim a través del cristal del desarrollo asistido por IA. Y vamos a ser honestos: la IA no es una solución mágica. Sin estructura, rompe DevOps más fuerte que cualquier cosa que haya visto en 15 años de trabajo en entornos enterprise.

El Problema

Déjame describir un equipo con el que trabajé hace un tiempo.

Era una tienda sólida de .NET + React sobre Azure Kubernetes Service, haciendo entregas a través de Azure DevOps. Setup clásico. Sus métricas DORA estaban bien: frecuencia de despliegue diaria, lead time de dos días, tasa de fallo en cambios alrededor del 10%.

Entonces desplegaron GitHub Copilot y un bot de code review con IA en toda la organización. Todo el mundo estaba emocionado.

Seis meses después:

- La frecuencia de despliegue subió (3x). Bien.

- El lead time se duplicó. Mal.

- La tasa de fallo se triplicó. Muy mal.

- Los reviewers empezaron a ignorar el bot de IA porque el 80% de sus comentarios eran falsas alarmas.

- Dos juniors mergearon un manifiesto de Kubernetes que no sabían explicar cuando producción se rompió.

Son el tipo de números que aparecen en el State of DevOps Report para equipos con alta adopción de IA pero poca disciplina de proceso. El informe lo dice claro: la IA no sustituye a las buenas prácticas de ingeniería. Amplifica lo que ya haces — para bien o para mal.

Si tu equipo está entregando más código pero se siente más lento, este artículo es para ti.

La Solución

Volvamos a lo básico. Gene Kim, Jez Humble, Patrick Debois y John Willis escribieron la 1ª edición del DevOps Handbook en 2016. La 2ª edición salió en 2021, con una breve mención al machine learning — pero era antes de que existiera ChatGPT. El libro sigue siendo el mejor resumen de por qué funciona DevOps, y se construye sobre tres ideas llamadas los Tres Principios.

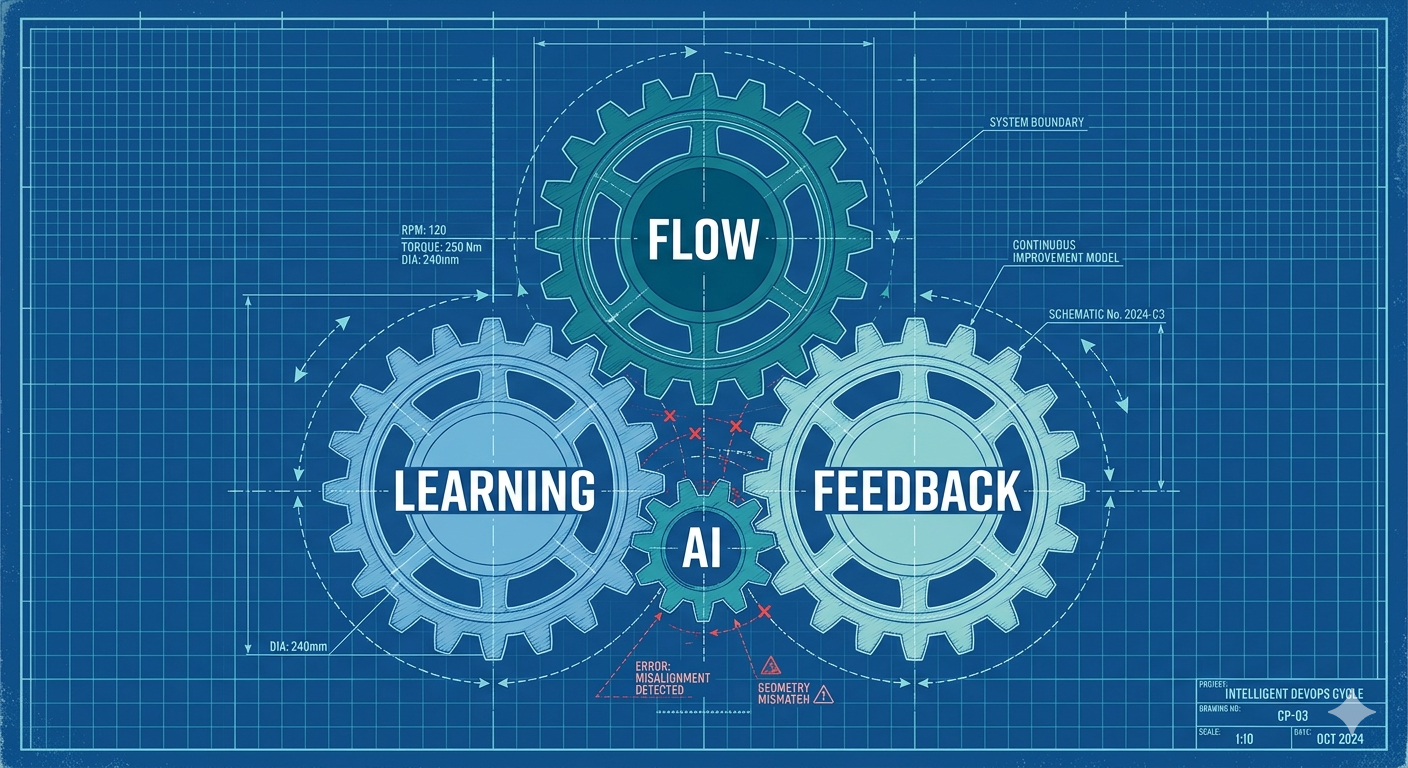

Primer Principio: Flujo

El trabajo debe moverse de forma fluida desde desarrollo hasta producción. Lotes pequeños. Trabajo visible. Sin grandes handoffs. Deberías poder empujar un cambio diminuto a producción con confianza.

Segundo Principio: Feedback

Los problemas deben detectarse rápido y enviarse aguas arriba. Telemetría en todas partes. Tests rápidos. Code review que capte problemas reales, no detalles de estilo. Si algo se rompe en producción, el equipo que lo escribió es el primero en enterarse.

Tercer Principio: Aprendizaje Continuo

El equipo mejora con el tiempo. Postmortems sin culpa. Experimentos seguros. Leer, formarse, compartir conocimiento. La deuda técnica se paga, no solo se acumula.

Aquí va la tesis de la serie:

La IA no soporta automáticamente los Tres Principios. Sin estructura, la IA rompe las tres: lotes más grandes, feedback más ruidoso y menos aprendizaje.

Esto no es un post anti-IA. Uso IA todos los días. Pero los equipos que ganan con IA son los que aplican enfoques estructurados. Vamos a ver tres de ellos en esta serie:

| Framework | Qué es | Dónde ayuda |

|---|---|---|

| SDD (Spec-Driven Development) | Escribe la especificación primero. La IA construye desde la spec, no desde prompts vagos. | Primer Principio (Flujo). Mantiene los lotes pequeños y verificables. |

| ATLAS | Checklist humana para todo el ciclo de vida: Architect, Trace, Link, Assemble, Stress-test. | Los tres Principios. Mantiene al humano en el loop. |

| GOTCHA | Estructura de prompt: Goals, Orchestration, Tools, Context, Heuristics, Args. | Segundo Principio (Feedback). Hace que la salida de la IA sea útil en vez de ruidosa. |

SDD tiene tracción real en la industria ahora mismo. GitHub Spec Kit y AWS Kiro se basan en la idea de que la spec es la fuente de verdad, no el código. ATLAS y GOTCHA son frameworks que aplico en mi propio trabajo. Juntos cubren lo que SDD por sí solo no cubre: el ciclo de vida de DevOps y el propio prompt.

Más sobre cada uno en los siguientes artículos. Por ahora, veamos qué pasa cuando un equipo no usa ninguno.

Ejecutar

Conoce a nuestro equipo de ejemplo. Necesitan integrar QuantumAPI — un servicio de encriptación post-cuántica — en su aplicación existente de .NET/React sobre AKS, antes de una auditoría de compliance en 8 semanas.

Nada exótico. Quieren:

- Encriptar campos sensibles en reposo usando el vault de QuantumAPI.

- Firmar las respuestas de la API usando ML-DSA (un algoritmo de firma post-cuántica).

- Rotar claves automáticamente cada 90 días.

Vamos a seguir a este mismo equipo durante toda la serie. Esto es lo que pasó cuando intentaron hacerlo con IA, pero sin ninguno de los tres frameworks.

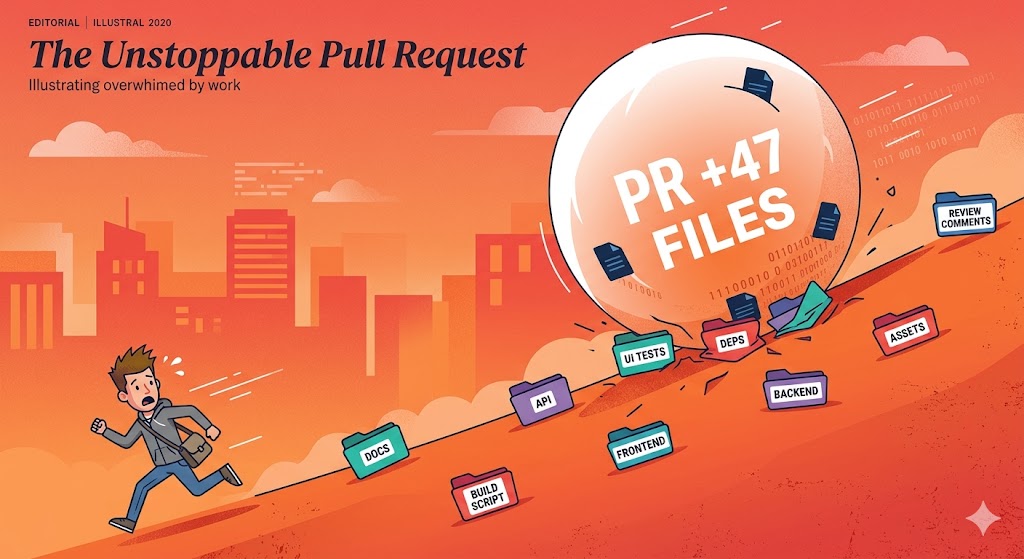

Escena 1 — El Primer Principio se rompe

Un dev senior abre Copilot Chat y escribe:

“Integra QuantumAPI en nuestra API y nuestro frontend. Necesitamos encriptación en reposo y respuestas firmadas.”

45 minutos después, la IA ha producido una pull request con:

- 47 archivos modificados

- Cambios en el middleware de autenticación (no se pidieron)

- Nueva lógica de retry en 12 controllers (no se pidió)

- Una nueva clase

QuantumApiClientcon 340 líneas - Cambios de frontend en 8 componentes React

- Una nueva imagen base de Docker

El reviewer abre la PR. Hace scroll durante 20 segundos. Cierra la pestaña.

// De la PR generada — uno de los 47 archivos

public class PortfolioController : ControllerBase

{

private readonly IQuantumApiClient _quantum;

private readonly IAuthMiddleware _auth; // ¿Por qué está auth aquí?

private readonly IRetryPolicy _retry; // ¿Por qué está retry aquí?

private readonly ILogger _logger;

public async Task<IActionResult> GetPortfolio(int id)

{

// 180 líneas de lógica generada, mezclando 4 responsabilidades

}

}El tamaño del lote pasó de 3 archivos (su PR manual típica) a 47 archivos. Esto es el Primer Principio roto. El equipo no va más rápido — está creando un bloque irrevisable.

Métrica: lead time de esta PR = 6 días. La media del equipo antes de la IA = 1,5 días.

Escena 2 — El Segundo Principio se rompe

Por fin revisan la PR. Su bot de code review con IA deja 22 comentarios:

- “Posible inyección SQL” (en un método que usa consultas parametrizadas con EF Core — falso positivo)

- “Falta null check” (sobre un tipo no-nullable — falso positivo)

- “Uso de algoritmo obsoleto” (sobre

ML-KEM-768, que es el estándar actual — el bot no sabe de PQC) - “Concatenación de strings insegura” (en un mensaje de log — falso positivo)

- …y 18 más

De 22 comentarios, 3 son issues reales. 19 son ruido.

[AI Review] Línea 142: "Uso de algoritmo obsoleto ML-KEM-768.

Considera migrar a AES-256."

-- Respuesta del developer: "ML-KEM-768 es post-cuántico. AES-256

no lo es. El bot se equivoca. Ignorar."Después de dos PRs más así, el equipo deja de leer los comentarios de la IA. Esto es el Segundo Principio roto. El feedback está ahí, pero la relación señal-ruido se ha hundido.

Métrica: comentarios atendidos = 14% (frente al 78% de los reviewers humanos).

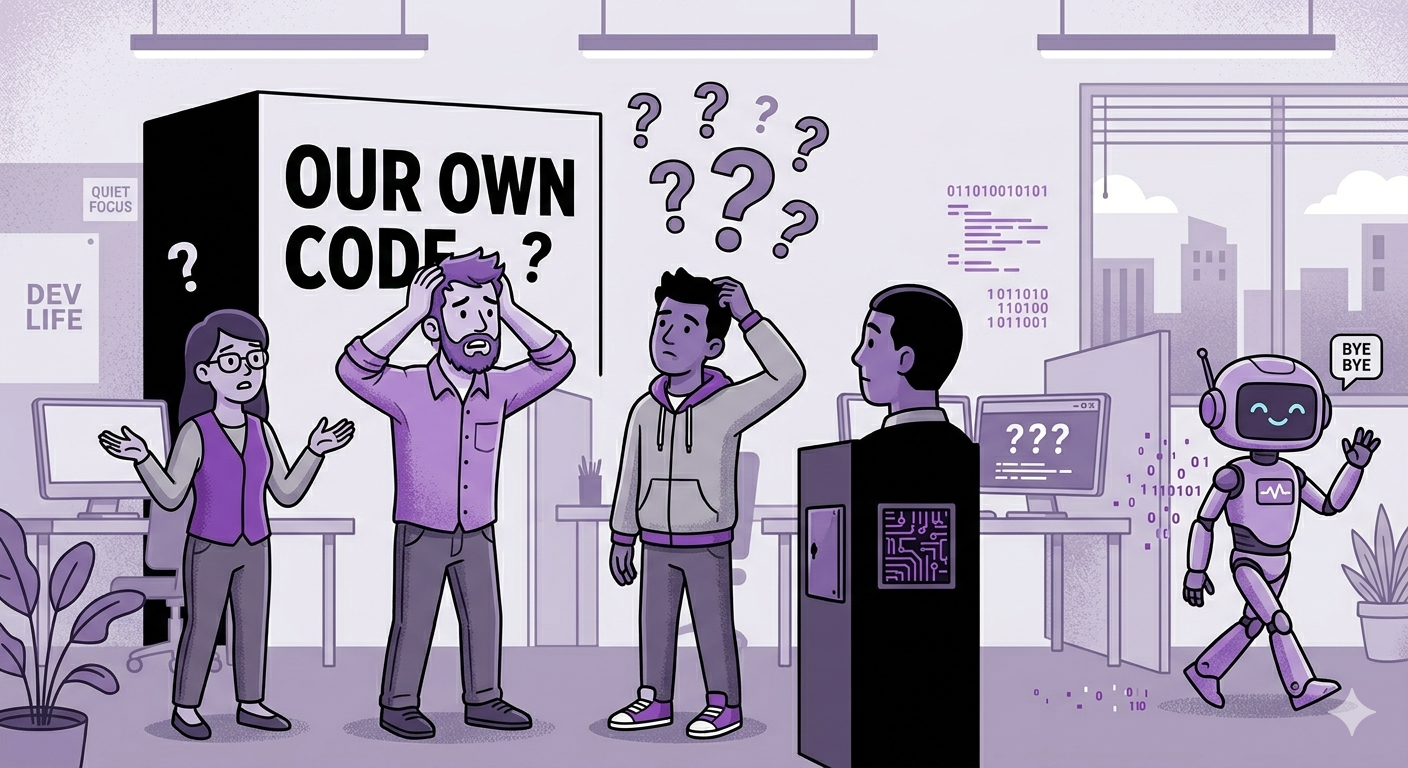

Escena 3 — El Tercer Principio se rompe

La PR se mergea. Todo funciona. La auditoría pasa.

Tres semanas después, producción se cae. La rotación de claves ha fallado en silencio. El job automatizado debía rotar el par de claves ML-KEM cada 90 días, pero se rompió al octavo día.

El ingeniero de guardia mira el código. Lo escribió Copilot. Nadie del equipo sabe explicar:

- ¿Por qué

ML-KEM-768y noML-KEM-1024? - ¿Qué hace el método

RotateKeysentre la línea 45 y la 120? - ¿Por qué hay una retry policy con backoff exponencial pero sin circuit breaker?

El dev original que lo “escribió” se encoge de hombros. “Copilot lo sugirió. Parecía correcto.”

Esto es el Tercer Principio roto. El código existe, pero el conocimiento no. El equipo entregó, pero no aprendió.

Métrica: bus factor para la integración de QuantumAPI = 0.

Qué hará este equipo a continuación

En los próximos 5 artículos vamos a arreglar cada una de estas escenas.

- Artículo 2: el equipo adopta SDD. La PR de 47 archivos se convierte en tres PRs de 5 archivos, cada una con una spec clara.

- Artículo 3: el equipo aplica GOTCHA a su reviewer de IA. Los 22 comentarios se convierten en 4 issues reales.

- Artículo 4: el equipo usa la IA como tutor, no solo como generador. El dev aprende de verdad qué es ML-KEM-768.

- Artículo 5: comparamos SDD, ATLAS y GOTCHA de forma honesta. Ninguno es una bala de plata.

- Artículo 6: construimos el playbook completo con DORA y métricas específicas de IA.

Plantilla

Antes del próximo artículo, pasa esta autoevaluación a tu equipo. Es una checklist corta, 15 preguntas repartidas entre los tres Principios. Puntúa cada pregunta de 0 a 2:

Primer Principio (Flujo):

- ¿Las PRs asistidas por IA son más pequeñas o más grandes que las manuales en tu repo?

- ¿Cuál es el tamaño medio de lote para cambios generados por IA?

- ¿Cuánto tiempo está una PR generada por IA en review frente a una manual?

- ¿Tienes un límite al tamaño de PR? ¿Se hace cumplir?

- ¿Puede un reviewer entender una PR de IA en menos de 10 minutos?

Segundo Principio (Feedback):

- ¿Qué porcentaje de comentarios de code review de IA atienden tus devs?

- ¿Mides la tasa de falsos positivos de tu reviewer de IA?

- ¿Tu reviewer de IA tiene contexto de tu dominio (PQC, finanzas, sanidad, etc.)?

- ¿Las alertas de producción están conectadas de vuelta al código generado por IA que las causó?

- ¿Reajustas o entrenas tus prompts de IA en base a los resultados de review?

Tercer Principio (Aprendizaje):

- ¿Cada dev puede explicar la última función escrita por IA que mergeó?

- ¿Emparejas juniors con IA, o los juniors codean solos con IA?

- ¿Se hacen postmortems en incidentes relacionados con IA?

- ¿Tenéis un documento interno compartido con patrones de IA que funcionaron (y los que no)?

- ¿El uso de IA es un tema en vuestras retros?

Puntuación 25-30: vas por delante del 95% de los equipos. Puntuación 15-24: típico. Hay margen para mejorar. Menos de 15: eres el equipo de este artículo.

El Reto

Pasa la autoevaluación en tu equipo esta semana. No hagas trampas — pregúntale a cada dev por separado y haz la media. Probablemente te sorprendas.

En el próximo artículo atacamos el Primer Principio de frente. Por qué la IA empuja hacia lotes más grandes, cómo SDD cambia el juego y cómo ATLAS mantiene al humano al mando. Con nuestro equipo de QuantumAPI como ejemplo recurrente — misma integración, pero esta vez hecha bien.

→ Artículo 2: Specs antes que código: Por qué la IA necesita SDD para mantener los lotes pequeños (próximamente)

Si esta serie te ayuda, considera patrocinarme en GitHub o invitarme a un café.

Esta es la parte 1 de 6 de la serie “Los Tres Principios en la Era de la IA”. Suscríbete en blog.victorz.cloud para recibir el próximo artículo.

Loading comments...